Dans un récent essai publié dans le New York Times, David DeSteno, professeur de psychologie à la Northeastern University, a posé une question provocante : la religion peut-elle rendre lIA plus morale ? Selon lui, la religion tire son pouvoir de transformation non pas de la doctrine ou des Écritures, mais de rituels physiques tels que le jeûne, la respiration consciente et la prière en communauté. LIA nayant ni corps ni capacité à éprouver de la compassion, de la gratitude ou des dilemmes moraux, ces mécanismes lui sont inaccessibles.

Cet argument, bien que convaincant, identifie mal le problème. Bien sûr, nous ne pouvons pas rendre l’IA vertueuse de la même manière qu’un moine en méditation se transforme par la pratique spirituelle. Mais la véritable question est de savoir qui détermine les valeurs intégrées dans les systèmes d’IA qui façonnent la manière dont des milliards de personnes prennent leurs décisions, et quelles traditions et hypothèses morales ces systèmes reflètent en fin de compte.

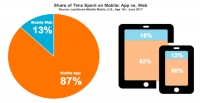

En quelques années seulement, l’IA est devenue une composante incontournable de la vie quotidienne. Dans une enquête mondiale Ipsos de 2025, 53 % des personnes interrogées ont déclaré que l’IA avait déjà changé leur vie, tandis que deux tiers s’attendent à ce qu’elle transforme encore davantage la société dans les années à venir.

L'influence croissante de l'IA trouve son origine dans le fait qu'elle est entraînée à partir de l'ensemble des connaissances, du langage et des comportements humains accumulés. De plus en plus, ces systèmes apprennent également par simulation, développant des capacités puissantes qui ne sont pas entièrement explicables, même pour leurs créateurs.

Si les gens utilisent l’IA pour gagner en productivité, ils commencent également à compter sur elle pour se sentir vus et compris. En ce sens, l’IA générative a dépassé le stade de l’utilité pour entrer dans celui de l’intimité, s’immisçant dans des espaces émotionnels autrefois réservés aux relations humaines. Chez les jeunes utilisateurs en particulier, les chatbots deviennent des confidents, offrant réconfort et conseils. Pour certains, l’IA est déjà la source privilégiée de réconfort et de conseil.

Mais une forte dépendance vis-à-vis des compagnons IA comporte des risques profonds, car elle est associée à la solitude et à une réduction de l’engagement social. Une grande partie de l’attrait de l’IA réside dans le fait que, contrairement aux relations humaines, elle offre une interaction sans friction. À long terme, le danger est qu’elle conditionne les gens à rechercher des relations qu’aucun être humain ne peut entretenir.

Un phénomène similaire se produit dans le domaine de la moralité et de la spiritualité, les gens se tournant de plus en plus vers les systèmes d’IA pour des questions de sens, d’éthique et de croyance. Beaucoup utilisent désormais l’IA pour résumer des textes sacrés, interpréter la doctrine religieuse et rechercher des conseils moraux.

Le problème n’est pas seulement réglementaire ou technique. Il concerne la manière dont les gens se comprennent eux-mêmes, dont ils interagissent les uns avec les autres et dont ils distinguent le bien du mal. Ce ne sont pas là des questions auxquelles de meilleurs modèles ou une conformité plus stricte peuvent répondre à eux seuls ; elles exigent du jugement, du contexte et de l’imagination morale. En bref, elles exigent de la sagesse.

C'est là que l'argument de DeSteno fait défaut. La valeur des traditions religieuses à l'ère de l'IA ne réside pas dans leur capacité à rendre les machines spirituelles, mais dans la préservation de siècles de raisonnement moral. À travers les cultures et les continents, les communautés religieuses continuent de jouer un rôle unique dans la formation de la compréhension morale. Les chefs religieux restent parmi les figures les plus dignes de confiance, en particulier dans les moments d’ambiguïté éthique ou de crise personnelle. Si l’IA peut simuler l’empathie, elle ne peut pas la ressentir, et n’a donc pas grand-chose à offrir dans de tels moments.

Dans le même temps, l’IA peut jouer un rôle puissant dans la protection des personnes vulnérables et le renforcement des communautés lorsqu’elle est utilisée avec prudence et de manière stratégique. Notre expérience combinée dans les domaines de l’application de la loi, de la protection de l’enfance et des communautés, de la technologie, des politiques publiques et de la collaboration interconfessionnelle — notamment par le biais de l’Interfaith Alliance for Safer Communities— nous a appris que l’IA peut aider à identifier les schémas de menace, à signaler les risques et à soutenir une intervention précoce.

Le travail difficile consistant à comprendre pourquoi des préjudices se produisent ne peut toutefois pas être automatisé. Restaurer la confiance au sein de communautés fracturées par la violence, l’exploitation ou la négligence nécessite des relations humaines, une crédibilité morale et une expérience vécue.

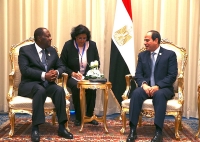

Dans cette optique, l’initiative Faith-AI Covenant a tenu sa table ronde inaugurale à New York en avril, réunissant des représentants de plus de 15 communautés religieuses et des grandes entreprises du secteur de l’IA, notamment OpenAI et Anthropic. L'initiative s'inspire de pays qui ont cherché à intégrer des cadres éthiques dans le développement de l'IA. Au premier rang d'entre eux figurent les Émirats arabes unis, qui abritent plus de 200 nationalités et toutes les grandes religions, et que Microsoft a récemment classés parmi les leaders mondiaux en matière d'adoption de l'IA sur le lieu de travail.

Le principe du Covenant est simple : puisque les modèles d’IA façonnent déjà la façon dont les gens pensent, interagissent et prennent des décisions, les valeurs qui y sont intégrées ne peuvent être déterminées uniquement par des processus techniques. Elles doivent également s’inspirer des traditions morales qui guident depuis longtemps les sociétés humaines. Plutôt que d’encoder la doctrine religieuse dans les cadres de gouvernance, l’objectif est de veiller à ce que les valeurs humaines et la responsabilité sociale restent au cœur de ces cadres.

En favorisant la collaboration entre les développeurs d’IA et les communautés religieuses, le Faith-AI Covenant cherche à relier l’architecture technique de ces systèmes aux fondements éthiques des sociétés sur lesquelles ils exercent une influence croissante. S’appuyant sur des discussions entre des experts en IA et des chefs religieux du monde entier, son objectif est de promouvoir des cadres moraux communs qui protègent la dignité, l’autonomie et la liberté cognitive, en veillant à ce que ces principes façonnent la manière dont les modèles d’IA sont conçus et déployés.

Afin de réduire le risque d’interprétations inexactes ou préjudiciables générées par l’IA, l’initiative soutient la création d’un corpus de connaissances religieuses vérifié et consensuel, transcendant les traditions et les langues. Elle encourage également les développeurs et les chefs religieux à concevoir des mécanismes de sécurité capables d’identifier et d’atténuer les préjudices tels que l’exploitation, la radicalisation et la manipulation.

Au cœur du Faith-AI Covenant se trouve la conviction que le progrès technologique et la sagesse morale des communautés religieuses ne sont pas en conflit l’un avec l’autre. L’IA est appelée à transformer tous les aspects de nos sociétés. La question est de savoir si cette transformation sera uniquement guidée par les capacités technologiques ou si elle sera orientée par les valeurs et les liens personnels qui font de nous des êtres humains.

By Dana Humaid Al Marzouqi and Joanna Shields

JDF TV

L'actualité en vidéo

JDF TV

L'actualité en vidéo