La bataille juridique qui oppose actuellement la startup Anthropic à ladministration du président américain Donald Trump révèle quelque chose de profondément troublant quant à létat actuel de la gouvernance de lIA. Une entreprise privée se montre en effet aujourdhui plus attachée aux garde-fous éthiques que larmée la plus puissante au monde.

Ce mois-ci, le département américain de la Défense a qualifié Anthropic de « risque pour la chaîne d’approvisionnement » de l’armée des États-Unis. Cette démarche inhabituelle fait suite à l’insistance de l’entreprise pour que des mesures de protection empêchent l’utilisation de sa technologie à des fins de surveillance de masse des Américains, ou d’intégration dans des armes entièrement autonomes. En réponse, le Pentagone a inscrit Anthropic sur une liste généralement réservée aux entités étrangères considérées comme des menaces pour la sécurité nationale. Anthropic a depuis intenté une action en justice pour contester cette désignation.

Quoi que l’on pense des motivations d’Anthropic, cet épisode souligne à quel point les cadres de gouvernance sont aujourd’hui mal alignés. Lorsque la responsabilité d’insister sur des limites éthiques fondamentales incombe à des entreprises privées, on peut clairement considérer que les systèmes censés protéger l’intérêt public contre des technologies potentiellement dangereuses sont en train d’échouer.

Fort heureusement, le Sommet sur l’impact de l’IA, qui s’est tenu au mois de février en Inde, a démontré qu’il n’était pas trop tard pour changer de cap. Partout à travers le monde, des startups développent des systèmes conçus explicitement pour un déploiement sûr et éthique de l’IA, de même qu’un certain nombre d’organisations de la société civile recourent à l’IA pour s’attaquer à des défis sociaux urgents, parmi lesquels les violences faites aux femmes et aux filles. Parallèlement, le coût des applications d’IA a chuté de près de 90 % ces dernières années, et la croissance des écosystèmes en open source a rendu de puissants outils accessibles à des acteurs de moindre envergure.

Telle est la révolution de l’IA à laquelle beaucoup d’entre nous aspirent depuis longtemps, une révolution faite d’avancées technologiques guidées par les valeurs démocratiques et le respect des droits de l’homme. Cette même vision a inspiré mes travaux autour de la Recommandation de l’UNESCO sur l’éthique de l’IA – tout premier cadre mondial de ce type – ainsi que des Principes de l’OCDE relatifs à l’IA.

L’expérience de l’Inde offre un modèle utile pour les pays désireux d’exploiter l’IA au service de l’intérêt public. En investissant massivement dans les infrastructures publiques numériques – notamment dans le système d’identité biométrique Aadhaar et dans une interface de paiement unifiée – l’Inde a démontré comment la technologie pouvait être déployée à grande échelle pour répondre aux besoins quotidiens des citoyens.

Le litige qui concerne Anthropic illustre néanmoins une tension croissante entre gouvernance responsable de l’IA et volonté des gouvernements d’attirer des investissements. Les modèles économiques des quelques entreprises américaines qui dominent actuellement le secteur de l’IA sont façonnés par une concurrence intense, à la fois entre elles et vis-à-vis de leurs équivalentes chinoises, et les dirigeants politiques se montrent hésitants à imposer des règles susceptibles de les faire fuir.

Cette dynamique a pu être observée lors du Sommet pour l’action en matière d’IA, qui s’est tenu l’an dernier à Paris, et au cours duquel les médias se sont concentrés sur les engagements d’investissement obtenus par la France auprès des géants technologiques, plutôt que sur des initiatives d’intérêt public telles que Current AI ou la Coalition pour le développement durable par le sport.

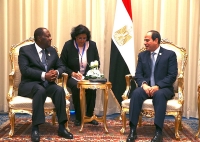

Ainsi, ces sommets font de plus en plus office de tribunes permettant aux gouvernements d’annoncer des investissements et des accords de centres de données. Constat révélateur, l’image emblématique du Sommet sur l’impact de l’IA en Inde était celle du Premier ministre Narendra Modi entouré de plusieurs PDG du secteur technologique, parmi lesquels Sundar Pichai d’Alphabet, Sam Altman d’OpenAI et Dario Amodei d’Anthropic.

À l’origine, l’objectif des rassemblements de ce type consistait à favoriser une coopération multilatérale sur la gouvernance des technologies transformatrices. Leur transformation en plateformes de promotion des investissements illustre à quel point il est devenu difficile de maintenir une surveillance digne de ce nom. Les dirigeants politiques expérimentent diverses approches, qu’il s’agisse de principes volontaires ou de législations contraignantes telles que l’AI Act de l’Union européenne. Pour autant, la concurrence géopolitique et les pressions commerciales continuent de pousser les gouvernements dans une course vers le bas.

Il ne s’agit bien entendu pas d’affirmer que tous les États devraient affronter les géants technologiques sur la scène mondiale. Il n’en demeure pas moins nécessaire que les gouvernements mettent de l’ordre dans leurs propres affaires, en établissant des règles claires, et en se dotant des moyens de les faire respecter.

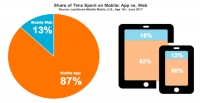

Les marchés publics constituent ici un puissant levier d’action, représentant environ 13 % du PIB dans les pays de l’OCDE. Les contrats d’achat public peuvent exiger la localisation des données, la transparence algorithmique, et mettre en place des mécanismes efficaces pour contester les décisions algorithmiques préjudiciables. Ils peuvent également imposer des tests de sécurité pour les systèmes à haut risque avant leur déploiement, tout en récompensant les entreprises qui respectent les normes éthiques, et en excluant celles qui ne le font pas.

Les marchés publics ne suffisent pas néanmoins ; la législation doit suivre. L’une des mesures les plus importantes que les gouvernements pourraient prendre consisterait à veiller à ce que les systèmes d’IA ne se voient jamais accorder la personnalité juridique, afin que la responsabilité incombe toujours à un être humain ou à une institution. Des interdictions strictes pourraient également établies concernant l’extraction de données sans consentement, la surveillance de masse, ainsi que l’utilisation de l’IA à des fins de profilage et de manipulation politique.

Les États ne sont pas tous en capacité de développer leurs propres modèles d’IA fondamentaux, et ne sauraient tous s’y essayer. Un chemin plus praticable consisterait à investir dans des modèles de moindre envergure, en open source, adaptés aux langues, aux nécessités et aux valeurs locales. Une telle stratégie exigerait certes des investissements, institutions, infrastructures et incitations appropriés – les « quatre I » – mais elle aurait le mérite de pouvoir produire des résultats à grande échelle.

La loi européenne sur l’IA constitue à ce jour la plus ambitieuse tentative d’application de cette approche. Ses détracteurs la qualifient de bureaucratique, d’encombrante, et la pression s’intensifie sur la Commission européenne pour qu’elle reporte sa mise en œuvre. Or, cette législation ne fait que réaffirmer un principe fondamental : la technologie n’est pas au-dessus des lois. Les laboratoires pharmaceutiques sont tenus de respecter des normes de sécurité avant de commercialiser de nouveaux médicaments, et les entreprises du bâtiment de certifier la sécurité structurelle des ponts qu’elles construisent. Les systèmes d’IA à haut risque doivent être soumis à la même exigence.

Le rythme de développement de l’IA souligne l’urgence de cette tâche. Les États qui ne parviendront pas à établir ces fondements prendront non seulement du retard dans la course technologique actuelle, mais risquent également de perdre le contrôle sur la manière dont les nouvelles technologies seront utilisées, dans un monde au sein duquel la puissance détermine de plus en plus les résultats, et où la responsabilité devient facultative.

La bonne nouvelle, c’est que les gouvernements et les consommateurs disposent encore de leviers d’action. L’accès aux marchés confère aux États une influence réelle sur la manière dont les produits d’IA sont déployés, et les organisations de la société civile ont démontré à maintes reprises qu’une pression publique coordonnée pouvait conduire les entreprises à modifier leurs comportements.

Les sociétés démocratiques ne sauraient confier la défense de leurs valeurs à des entreprises privées. Elles doivent mettre en place les institutions, les lois et les capacités permettant de rendre inutile cette dépendance, avant que le coût de l’inaction ne devienne trop élevé.

Par Gabriela Ramos

JDF TV

L'actualité en vidéo

JDF TV

L'actualité en vidéo