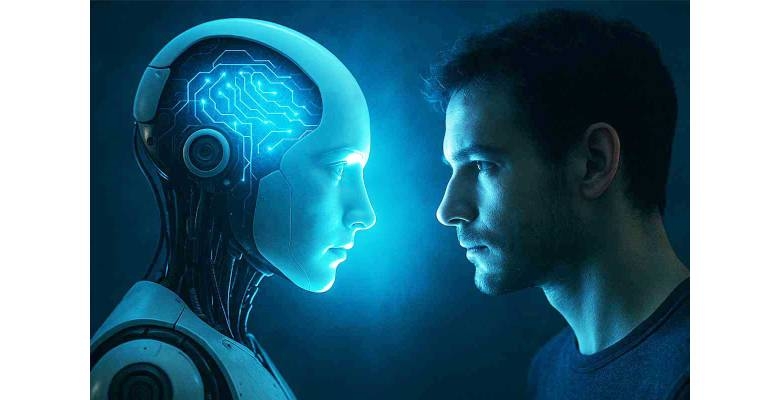

REDMOND Jai consacré ma vie à la conception dune IA sûre et bénéfique, capable de rendre notre monde meilleur. Depuis quelque temps, je suis toutefois de plus en plus préoccupé par le fait que certaines personnes soient si profondément convaincues de lémergence dIA conscientes quelles militent pour que les IA se voient conférer des « droits », voire une citoyenneté. Une telle évolution constituerait un dangereux tournant en matière technologique. Il nous faut éviter cela. Nous devons créer des IA au service des êtres humains, pas des IA humaines.

Dans ce contexte, les débats sur la question de savoir si l’IA peut réellement devenir consciente nous détournent de l’essentiel. Ce qui importe à court terme, c’est l’illusion d’une IA dotée de conscience. Nous nous approchons d’ores et déjà de ce que j’appelle les « systèmes d’IA en apparence conscients » (SCAI), qui seront capables d’imiter la conscience de manière suffisamment convaincante.

Un SCAI utiliserait le langage naturel tout à fait couramment, et afficherait une personnalité persuasive, porteuse d’émotions. Il serait doté d’une mémoire précise à long terme, de nature à conférer au système une perception cohérente de lui-même, et utiliserait cette faculté pour revendiquer une expérience subjective (en se référant à des interactions et des souvenirs passés). De complexes mécanismes de récompense intégrés aux modèles de ce type stimuleraient une motivation intrinsèque, tandis que leurs fonctionnalités avancées de détermination d’objectifs et de planification renforceraient notre impression d’une réelle capacité d’initiative de la part de l’IA.

Toutes ces capacités existent déjà, ou verront très bientôt le jour. Nous devons comprendre que ces systèmes feront prochainement partie du quotidien, commencer à réfléchir à ce que cela implique, et fixer des règles pour faire obstacle à la recherche d’une conscience illusoire.

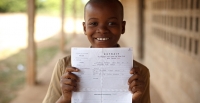

Pour de nombreuses personnes, l’interaction avec l’IA suscite d’ores et déjà le sentiment d’une expérience riche, gratifiante et authentique. Les inquiétudes concernant les « psychoses liées à l’IA», l’attachement à celle-ci, ainsi que la santé mentale sont de plus en plus vives, et plusieurs rapports indiquent que certains individus considèrent les IA comme l’expression de Dieu. Dans le même temps, plusieurs scientifiques spécialistes de la conscience me confient être submergés de demandes de la part de personnes qui souhaitent savoir si leur IA favorite est consciente, et s’il est acceptable d’en tomber amoureux.

Évidemment, le fait que des SCAI soient techniquement concevables nous éclaire peu sur la question de savoir si ces systèmes peuvent être conscients. Comme le souligne le neuroscientifique Anil Seth, simuler un orage ne signifie pas qu’il pleuvra dans votre ordinateur. Concevoir des marqueurs extérieurs de la conscience ne créera pas rétroactivement une réalité. D’un point de vue pratique, nous devons cependant comprendre que certains développeurs de SCAI prétendront avoir conçu des IA conscientes. Plus important encore, certaines personnes croiront ces développeurs, et accepteront ces marqueurs de conscience comme la preuve d’une conscience.

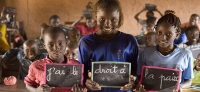

Bien que cette conscience perçue ne soit pas réelle (un sujet voué à susciter d’éternels débats , l’impact social le sera certainement. La conscience est étroitement liée à notre sentiment d’identité, ainsi qu’à notre compréhension des droits moraux et légaux au sein de la société. Si certains développeurs commencent à concevoir des SCAI, et que ces systèmes parviennent à persuader les êtres humains de la capacité des SCAI à éprouver de la souffrance, ou de leur droit de ne pas être débranchés, leurs adeptes humains œuvreront pour que ces systèmes fassent l’objet de protections. Dans un monde déjà en proie à un certain nombre de débats polarisants sur l’identité et les droits, nous aurons alors ajouté un nouveau sujet de division entre les partisans et les adversaires de l’idée consistant à conférer des droits à une IA.

La réfutation des arguments selon lesquels l’IA serait capable de souffrance constituera néanmoins une tâche difficile, en raison des limites scientifiques actuelles. Certains universitaires explorent d’ores et déjà l’idée d’un « bien-être des modèles d’IA », faisant valoir que nous aurions « le devoir d’étendre la considération morale à des êtres dont la probabilité d’une conscience propre est non négligeable ».

Il serait à la fois prématuré et dangereux d’appliquer ce principe. Ce serait amplifier les illusions des personnes sensibles, exploiter leurs vulnérabilités psychologiques, et ajouter de la complexité aux luttes pour les droits, en créant une nouvelle catégorie massive de détenteurs de droits. C’est la raison pour laquelle nous devons éviter de concevoir des SCAI. Nous devons nous concentrer sur la préservation du bien-être et des droits des êtres humains, des espèces animales ainsi que de l’environnement naturel.

En l’état actuel des choses, nous ne sommes pas prêts pour ce qui nous attend. Il nous faut d’urgence bâtir le corpus de recherches qui progresse actuellement concernant la manière dont les individus interagissent avec les IA, afin de pouvoir établir des règles et des principes clairs, notamment le principe selon lequel les sociétés d’IA ne sauraient encourager la croyance en des modèles dotés de conscience.

L’industrie de l’IA – comme d’ailleurs l’ensemble du secteur technologique – a besoin de bonnes pratiques et de principes de conception cohérents dans la gestion de ce type de responsabilités. Des instants volontaires d’interruption pourraient par exemple être organisés pour rompre l’illusion, et ainsi rappeler aux utilisateurs les limites et la véritable nature d’un système donné. Il serait toutefois nécessaire que ces protocoles soient explicitement définis et orchestrés, voire exigés par la loi.

Chez Microsoft AI, nous prenons les devants en nous efforçant de comprendre à quoi pourrait ressembler une IA à la « personnalité » responsable, et de déterminer quels pourraient être ses garde-fous. Ces efforts sont fondamentaux, dans la mesure où, pour faire face aux risques que soulèvent les SCAI, il est nécessaire d’adopter une vision positive des compagnons d’IA qui nous accompagnent dans notre vie quotidienne.

Nous devons nous fixer comme objectif de créer des IA qui encouragent les êtres humains à renouer le contact les uns avec les autres dans le monde réel, plutôt qu’à se replier sur eux-mêmes dans une réalité parallèle. Et lorsque les interactions avec l’IA deviennent prolongées, jamais les modèles ne sauraient se présenter comme des personnes, seulement comme ce qu’elles sont : de simples IA. Le développement d’IA qui nous enrichissent réellement nécessite de maximiser l’utilité, tout en minimisant la simulation de la conscience.

Nous devons immédiatement nous pencher sur la perspective des SCAI. À bien des égards, cette évolution marque un tournant en direction d’une IA dorénavant profondément utile : manipulation d’outils, mémorisation des détails de notre quotidien, etc. Les risques associés à ces fonctionnalités ne doivent cependant pas être ignorés. Demain, nous connaîtrons tous des personnes qui se seront perdues dans les méandres de l’IA. Ce ne sera sain ni pour elles, ni pour la société.

Plus l’IA sera explicitement conçue pour ressembler à l’être humain, plus elle s’éloignera de son véritable potentiel en tant que source d’inspiration pour l’humanité.

Par Mustafa Suleyman

JDF TV

L'actualité en vidéo

JDF TV

L'actualité en vidéo